Kamica nerkowa a AI

Coraz więcej pacjentów, zamiast od razu udać się do lekarza, najpierw konsultuje swoje objawy z chatbotem. Sztuczna inteligencja odpowiada szybko, jasno i bez kolejek. Ale czy jej odpowiedzi są bezpieczne dla pacjenta? To pytanie zadali sobie naukowcy i studenci Uniwersytetu Medycznego we Wrocławiu, którzy przeanalizowali, jak modele językowe radzą sobie z najczęstszymi pytaniami dotyczącymi kamicy układu moczowego.

Badanie, opublikowane w czasopiśmie Artificial Intelligence Review, pokazuje, że odpowiedzi generowane przez AI są zazwyczaj poprawne i merytorycznie wartościowe. Jednocześnie ujawnia ich największą słabość: nie tyle oczywiste błędy, ile brak pełnego kontekstu klinicznego, który w medycynie jest kluczowy.

Największe ryzyko to „prawie dobre” odpowiedzi

Modele językowe bardzo rzadko udzielały odpowiedzi całkowicie błędnych. Znacznie częściej problem dotyczył informacji częściowo trafnych – takich, które brzmią wiarygodnie, ale pomijają istotne szczegóły diagnostyczne lub terapeutyczne. To właśnie one mogą prowadzić do błędnych decyzji po stronie pacjenta.

– Z klinicznego punktu widzenia ważniejsze od oczywistych błędów są odpowiedzi częściowo trafne – bo to właśnie one mogą być dla pacjenta najbardziej mylące, gdy brzmią wiarygodnie, ale nie oddają pełnego kontekstu diagnostycznego lub terapeutycznego – podkreśla współautor badania, Wojciech Tomczak, lekarz rezydent i doktorant z Uniwersyteckiego Centrum Urologii.

Kamica nerkowa

Kamica układu moczowego to choroba, w której sposób leczenia zależy od wielu czynników – od obserwacji i leczenia zachowawczego, po interwencje zabiegowe. Właśnie dlatego uproszczone odpowiedzi mogą być szczególnie ryzykowne.

– Odpowiedzi błędne lub jedynie częściowo trafne są w tej kategorii szczególnie niebezpieczne, ponieważ mogą skłaniać pacjenta do samoleczenia albo do lekceważenia objawów alarmowych – zaznacza współautor.

W praktyce oznacza to, że pacjent, bazując na odpowiedzi AI może zbyt długo zwlekać z wizytą u lekarza albo podjąć niewłaściwe działania na własną rękę. W skrajnych przypadkach konsekwencje mogą być bardzo poważne, łącznie z utratą funkcji nerki czy ciężkimi zakażeniami, a nawet utratą życia.

Dlaczego AI wydaje się wiarygodna?

Chatboty mają ogromną przewagę komunikacyjną: odpowiadają szybko, jasno i w uporządkowany sposób. Problem polega jednak na tym, że pacjenci często oceniają odpowiedzi przede wszystkim przez pryzmat formy, a nie kompletności czy zgodności z aktualną wiedzą medyczną.

– Z perspektywy pacjenta różnica między odpowiedzią rzetelną a odpowiedzią jedynie brzmiącą wiarygodnie może nie być wyraźnie zauważalna, ponieważ odbiorca najczęściej ocenia komunikat przez pryzmat jego zrozumiałości i pozornej wiarygodności – zaznacza badacz z Uniwersyteckiego Centrum Urologii UMW.

To sprawia, że nawet uproszczone lub niepełne informacje mogą zostać uznane za wystarczające.

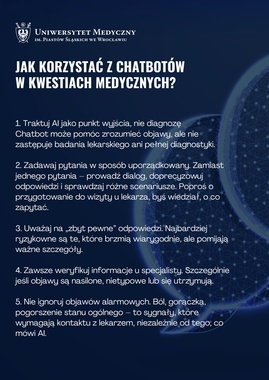

AI jako wsparcie

Autorzy badania podkreślają, że modele językowe mają realny potencjał w edukacji zdrowotnej. Pomagają zrozumieć problem, uporządkować wiedzę i przygotować się do rozmowy z lekarzem. Warunkiem jest jednak świadome korzystanie z tych narzędzi.

– Ostateczna ocena sytuacji zawsze powinna jednak należeć do lekarza - podkreśla Wojciech Tomczak.

Kluczowa pozostaje więc rola konsultacji medycznej, w której uzyskane wcześniej informacje mogą zostać zweryfikowane i osadzone w kontekście konkretnego przypadku.

Technologia to tylko częściowe rozwiązanie

Badanie zespołu z Uniwersytetu Medycznego we Wrocławiu pokazuje, że rozwój AI w medycynie nie eliminuje potrzeby edukacji zdrowotnej. Wręcz przeciwnie. Pacjenci potrzebują wiarygodnych źródeł wiedzy, umiejętności krytycznej oceny informacji oraz łatwego dostępu do specjalistów.

Chatbot może być pierwszym krokiem w zrozumieniu objawów. Nie powinien być ostatnim.

Materiał powstał na podstawie artykułu:

The quality of AI-generated answers for patient inquiries on urolithiasis: a comparative study of ChatGPT and Deepseek, Wojciech Tomczak, Jan Łaszkiewicz, Łukasz Nowak, Łukasz Biesiadecki, Klaudia Molik, Katarzyna Grunwald, Joanna Chorbińska, Bartosz Małkiewicz, Tomasz Szydełko, Wojciech Krajewski

Szukaj

Szukaj